제가 공부한것을 끄적인 내용입니다.

자세한 내용은 아래 링크를 참조하는게 더욱 좋습니다.

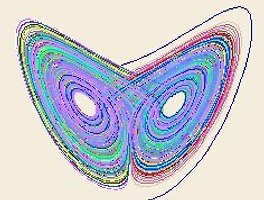

1. RNN Recurrent Neural Network 순환신경망

- 히든 노드가 directed cycle 형성

- 인공신경망의 종류

- 음성 / 문자등 순차적인 데이터에 적합

1.2 내부 구조

내부에 루프를 가진 네트워크 == 정보의 지속성

상황에 맞게 RNN을 붙여서 사용한다.

1.3 RNN의 내부 구조식

- ht (히든 노드)= tanh ( 이전 히든 노드 + 현재 input + bh)

- yt (출력값) = ht(히든노드) + by

1.4. RNN의 장기 의존성 문제 (the problem of long term dependencies)

적절한 정보와 그 정보가 필요한 곳과의 차이(Gap)가 적을 경우 RNN은 과거 정보를 이용하여 학습이 가능하다. 하지만 단어와 단어 사이의 gap이 넓을 경우엔 잘 동작하지 못한다.

이를 극복하기 위 LSTM이 나오게 된다.

2. LSTM - Long Short term Memeroy network

장기 의존성을 학습하는 RNN의 종류

오랫동안 정보를 기억하는 기능을 가지고 있다.

2.1 LSTM 특징

Cell state

- 컨베이어 벨트

- 장기 정보를 가져가는 역활

2.2 LSTM의 동작

1) Forget Gate Layer

cell state에 어떤 정보를 버릴지, 유지할지 결정

sigmoid를 통해 f_t = [0, 1]로 완전 제거, 완전 유지를 결정

2) input

- input gate layer (sigmode) : 어떤 값을 갱신할지 결정

- tanh layer : cell state에 더해질수 있는 새로운 후보값 생성

- 1번과 2번을 합쳐 최종 cell state를 갱신할 값을 만듬

3) 새로운 cell state로 갱신

forget gate와 input의 값으로 cell state 값 갱신

4) 무엇을 출력할지 결정

'ML > 인공지능' 카테고리의 다른 글

| 이상감지 (정리) (0) | 2021.05.25 |

|---|---|

| random forest // isolation forest 공부한한 내용 정리 (0) | 2021.05.21 |

| 신경 회로망 모델 (0) | 2009.11.15 |

| ,,,,,,, (0) | 2009.05.18 |

| 이놈의 AI, 생각한다라는건 뭘까? (0) | 2009.05.04 |